研究概要

私たちはジェスチャーを使って物事を伝えたりします。

ジェスチャーは世界中に様々存在し、受け取り方も人それぞれです。

mediapipeを用いて手の動きを学習させた機械学習モデルを、ゲームに落とし込んだら面白いのではないかと考えました。

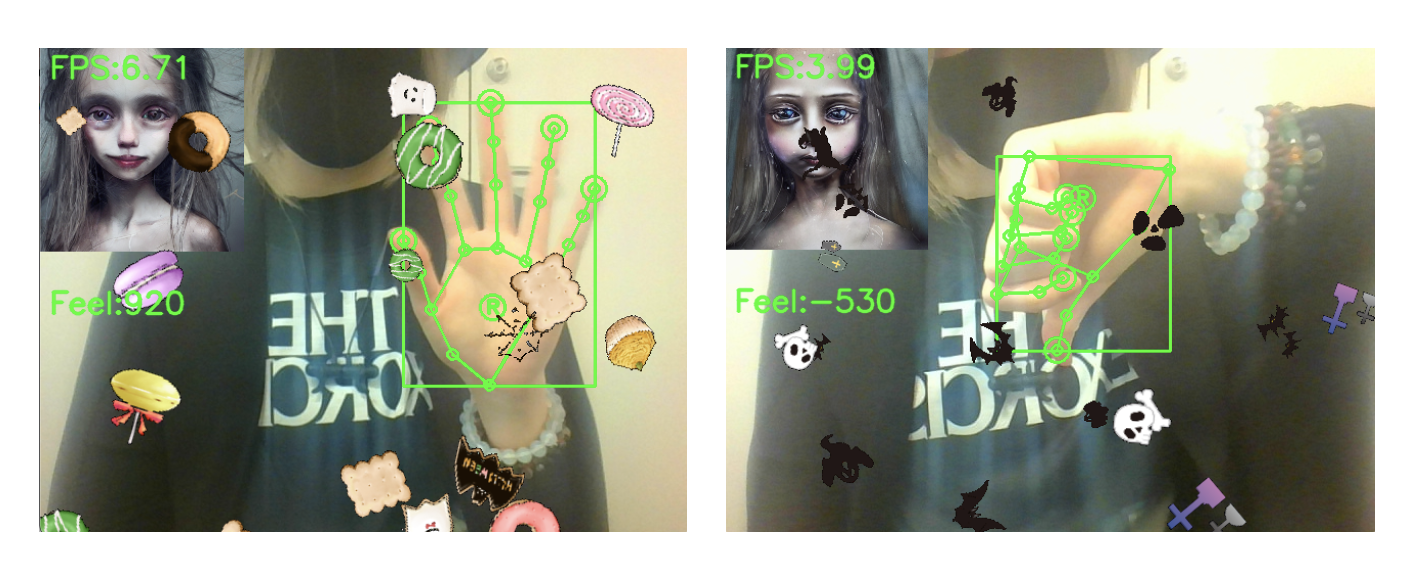

「ソフィアちゃん」はカメラの前でジェスチャーをすると、それがpositiveなジェスチャーなのか

negativeなジェスチャーなのかを判断し、

キャラクターが反応してくれるシステムです。

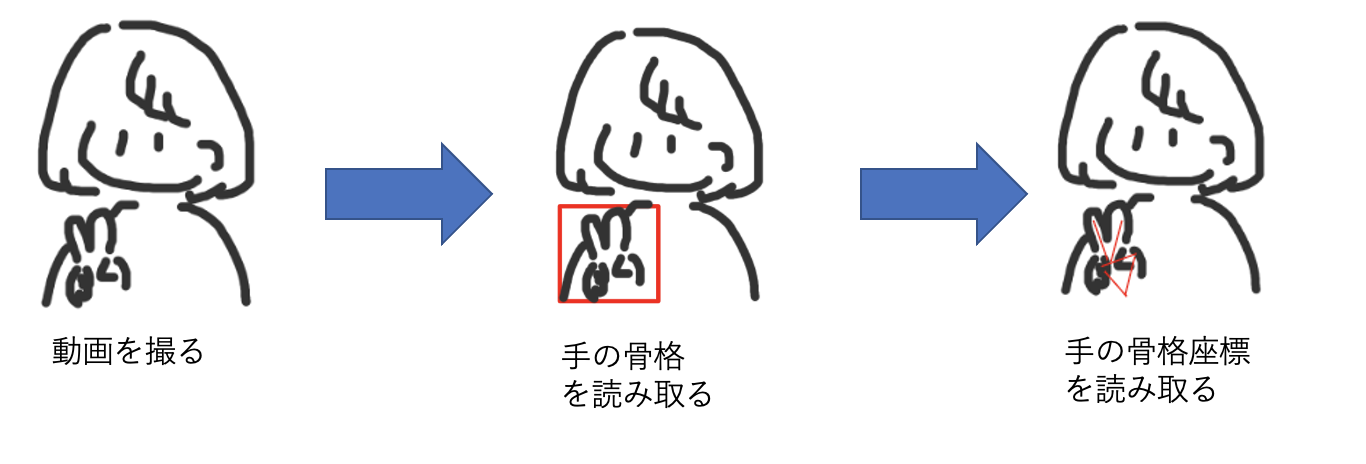

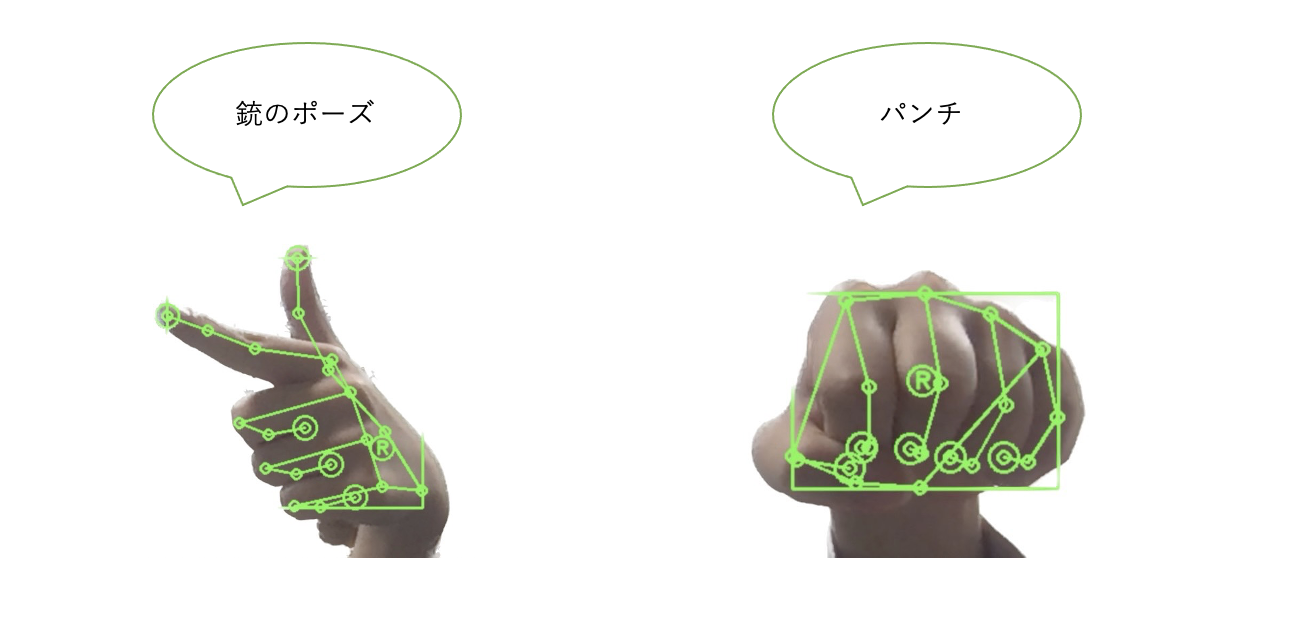

ジェスチャーの撮影・座標の取得

リアルタイムで手のジェスチャーを学習させます。

手の骨格を読み取り、手の骨格座標を取得し、座標データを集めました。

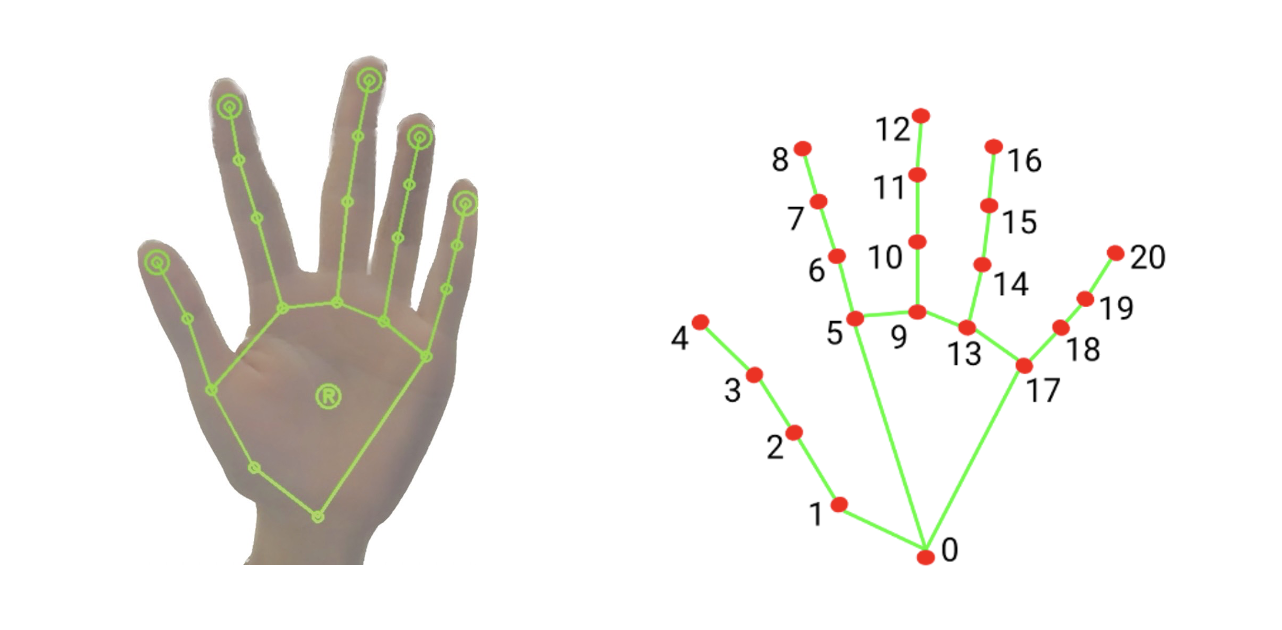

手の部位ごとに座標の取得

mediapipeを用いて手の部位ごとに21個座標を取ります。

そして、ランドマーク0を(0,0,0)とした座標に設定しました。

座標データの取り込み

良いジェスチャーをpositiveに、悪いジェスチャーをnegativeとしました。

読み込んだpositiveとnegativeの座標データにラベルを付けました。positiveは1、negativeは-1としました。

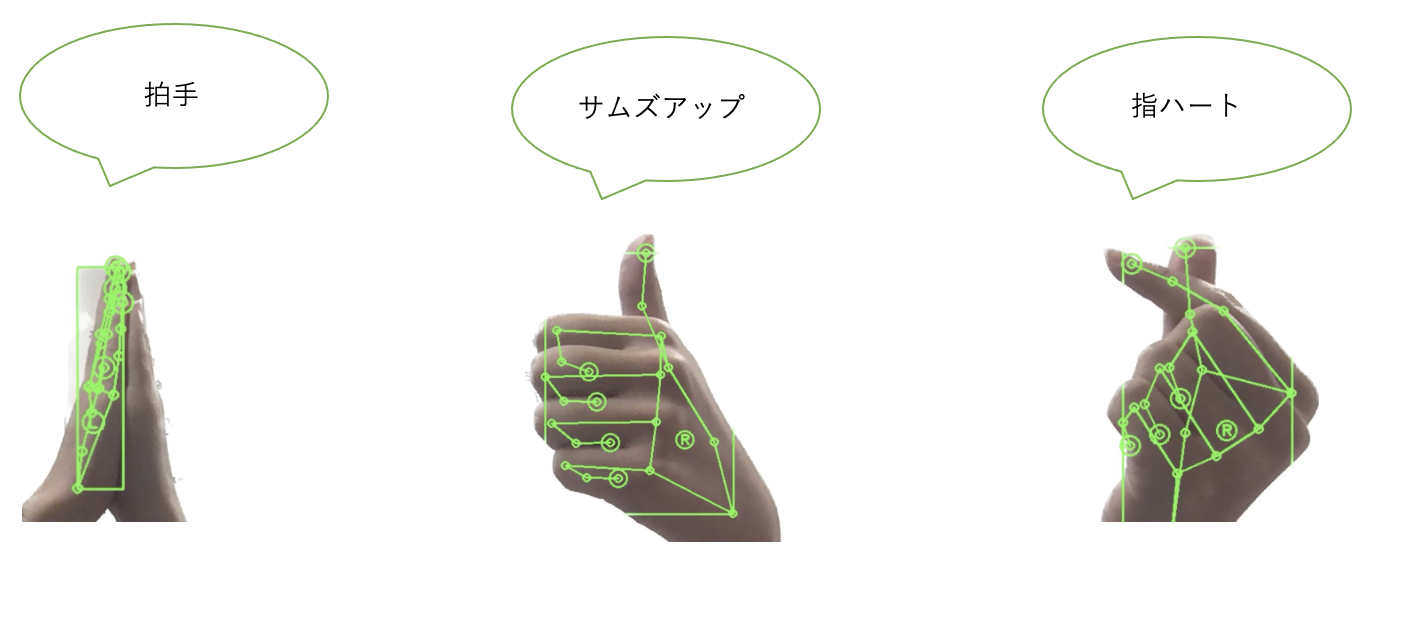

以下のような動画を撮って、座標データを取り込みました。

positive動画

手を振る・サムズアップ・指ハート・なでる・拍手 etc.

negative動画

パンチ・サムズダウン・銃のポーズ・中指・殴る etc.

手の動きの判定

機械学習アルゴリズムの一つであるRandomForestを用いて、リアルタイムで取り込んだ手の動きがpositiveな動きなのか、negativeな動きなのかを判定します。