技術調査

ここでは、このテーマで進めていく上で必要となった技術や学んだことについて紹介いたします。

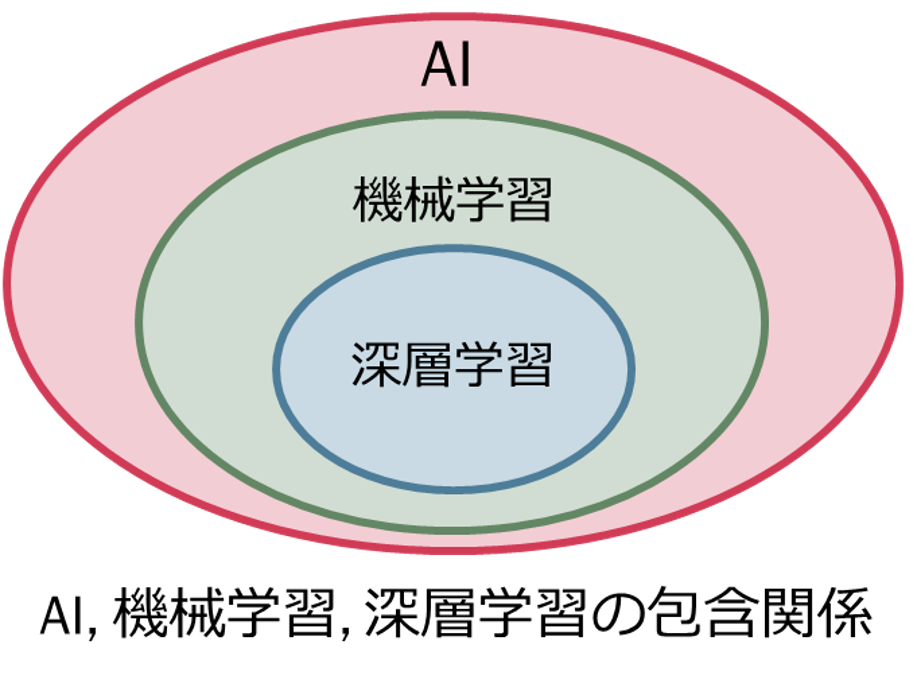

AIとは

AIとは厳密的な定義は(広義過ぎるので)現時点ではないですが、一般的に人間の知的行動を人工的に再現する技術を指します。

機械学習とは

機械学習とは、AIを実現する技術の1つで、コンピュータ(機械)に莫大なデータを読み込ませそのデータに潜んでいるパターンを見つけて学習し分析する手法です。

深層学習とは

深層学習とは人間の神経細胞を模したニューラルネットワークを用いた機械学習の中の1つでありデータの背景にあるルールやパターンを学習するために多層的に構造で考える方法です。 ここまでの説明を踏まえて、AI,機械学習,深層学習の関係を示すと以下のようになります。

言語モデルとは

言語モデルとは、文章の並び方に確率を割り当てた確率モデル(=ある現象がおこる確率を数学的に表した物)です。

例を挙げると、人間が理解できるような自然な文章の並びに対して文章であるという確率を割り当て、一方文章として成り立っていない並びには確率を低く割り当てます。

"言語モデル"自体はかなり古い歴史をもっています。

しかし、昨今のように実用的なものとして急速に普及していったのはごく最近です。

2018年に"BERT"という深層学習技術を用いた新しいアーキテクチャによる言語モデルが発表されました。

BERTは文章を文頭と末尾の双方向から事前学習するように設計されていて、従来のモデルよりも文章全体の意味を捉えることができ、規模を大きくすることでその精度が向上するという特徴があります。

生成AIとは

生成AIには、厳密な定義はありません。あえて言うのであれば、名前の通り文章や画像、音声など様々なコンテンツを生成できてかつコンテンツを生成する学習能力をもつAIといえます。

特徴としては、生成するだけではなく生成するために学習するというものがあります。

LLMとは

LLMとは、非常に巨大なデータセットと深層学習技術を用いて構築された言語モデルです。

ここでいわれる「大規模」とは、『計算量』『データ量』『モデルパラメータ量』が巨大化したことを指します。

LLMは生成AIの一部です。

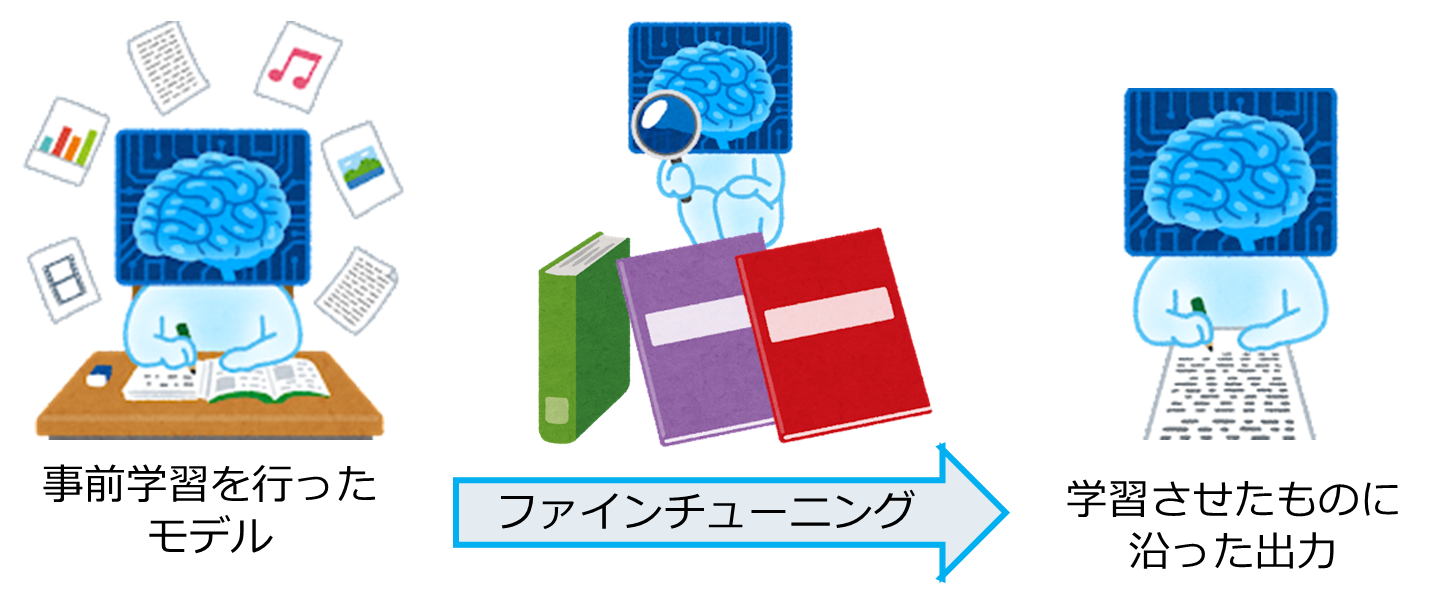

ファインチューニング(Fine-Tuning)とは

あるコーパスを使って事前学習を行ったモデルに対して追加のコーパス(=テキストデータをコンピュータが使えるように構造化したもの)を用いて既存モデルを微調整することです。

これにより、学習したコーパスの入出力例に沿った出力が行われるため、ある目的に特化した新しいモデルを作ることが可能になります。

おまけ:AIとGPU

ここで簡単に機械学習においてGPUが使われる、あるいは重要とされる理由について紹介いたします。

簡単にいうのならGPUの計算能力が高さとコア数の多さを活かすことで処理能力が向上するためです。

もう少し説明すると、GPUといえば名の通りPCのグラフィックス(=画像などを出力させる機能)を担当している機械であり、グラフィックというものは機械の中では行列として扱われています。

また、コア数の多さは多いほどよりたくさんの並列処理が可能になり、GPUはCPUよりもたくさんのコア数を持っています。

これらの特徴をAIを作るために必要な膨大な量の行列演算に使うことで、飛躍的に計算する時間がへり処理能力が向上します。

そのため、機械学習においてGPUが重要になっているのです。